최근 AI 계를 떠들 석 하게 만들었던 딥시크(DeepSeek)에 대한 관심은 아직 현재 진행형이다. 나 또한 이전 글 에서 갑자기 딥시크의 AI 모델이 관심을 받고 미국이 발칵 뒤집혔는지 포스팅 하였다.

그 중 내가 가장 관심 있던 것은 딥시크가 오픈소스로 공개되어 있고 로컬 환경에서 설치해 네트워크가 필요 없이 내 컴퓨팅 자원을 이용해 동작 시킬 수 있다는 점 이였다. 그래서 이번 포스팅 에선 딥시크를 직접 PC 에 설치해 보고 사용해 보고자 하는데 이때 이용할 것은 올라마(Ollama) 이다.

콘텐츠

올라마(Ollama)

올라마(Ollama)는 로컬 환경에서 대형 언어 모델(LLM)을 실행하는 프레임워크(Framework)다. 지금 설치하려는 딥시크(DeepSeek)-R1 외에도 Llama 3.3, Phi-4, Gemea 2 등을 설치해 사용할 수 있다.

올라마가 없이 딥시크와 같은 AI 모델을 설치할 수 있지만 공식 문서와 커뮤니티 등을 참고해 하드웨어와 OS 환경 등을 고려해 설치를 진행해야 하므로 보편적으로 LLM 모델은 올라마를 이용해 설치하게 된다.

올라마 설치 방법

올라마는 공식 홈페이지를 통해 다운로드 할 수 있다. 다운로드 버튼을 누를 시 OS 에 따라 받을 파일을 선택할 수 있는데 지원 OS 는 macOS, Linux, Windows 로 크로스 플랫폼을 지원하며 나의 경우 Windows 환경에서 다운로드를 진행했다. (이건 다른 소리지만 공식 홈페이지의 라마를 기반으로 한 로고가 좀 귀엽다.)

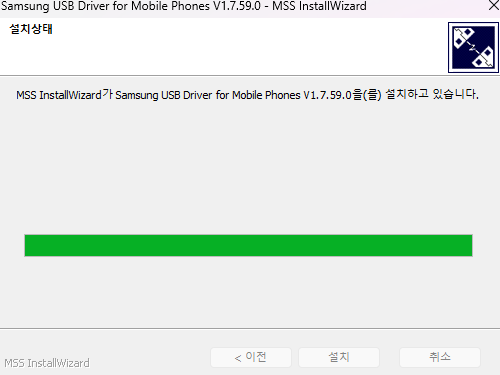

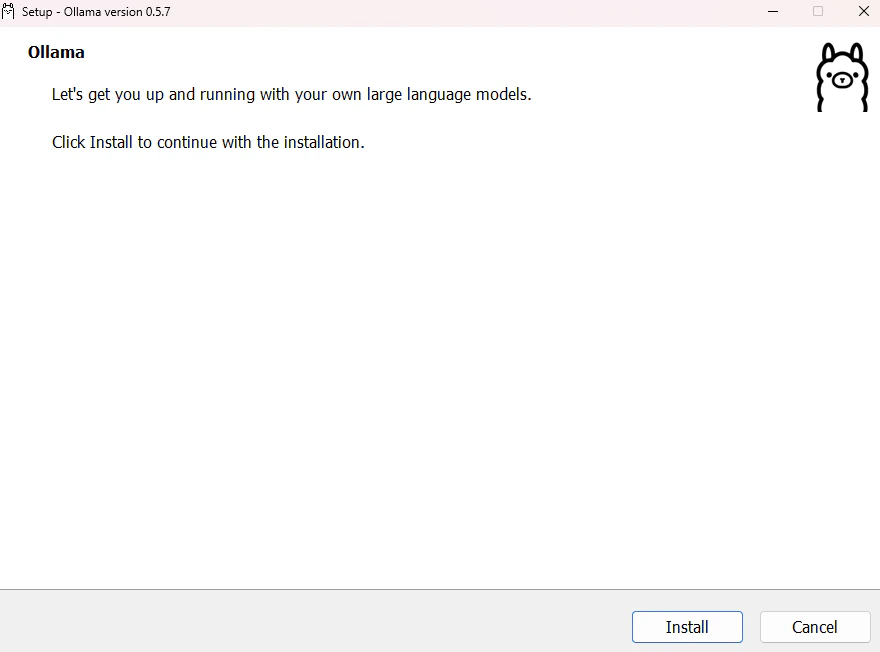

다운로드 파일은 exe 형태로 제공 되었고 약 760mb 정도의 용량을 지니고 있다.

파일을 실행 후 초기 화면에서 install 을 누르면 바로 설치가 진행 되며 user > 사용자 폴더 밑 AppData 쪽 경로에 설치가 진행된다.

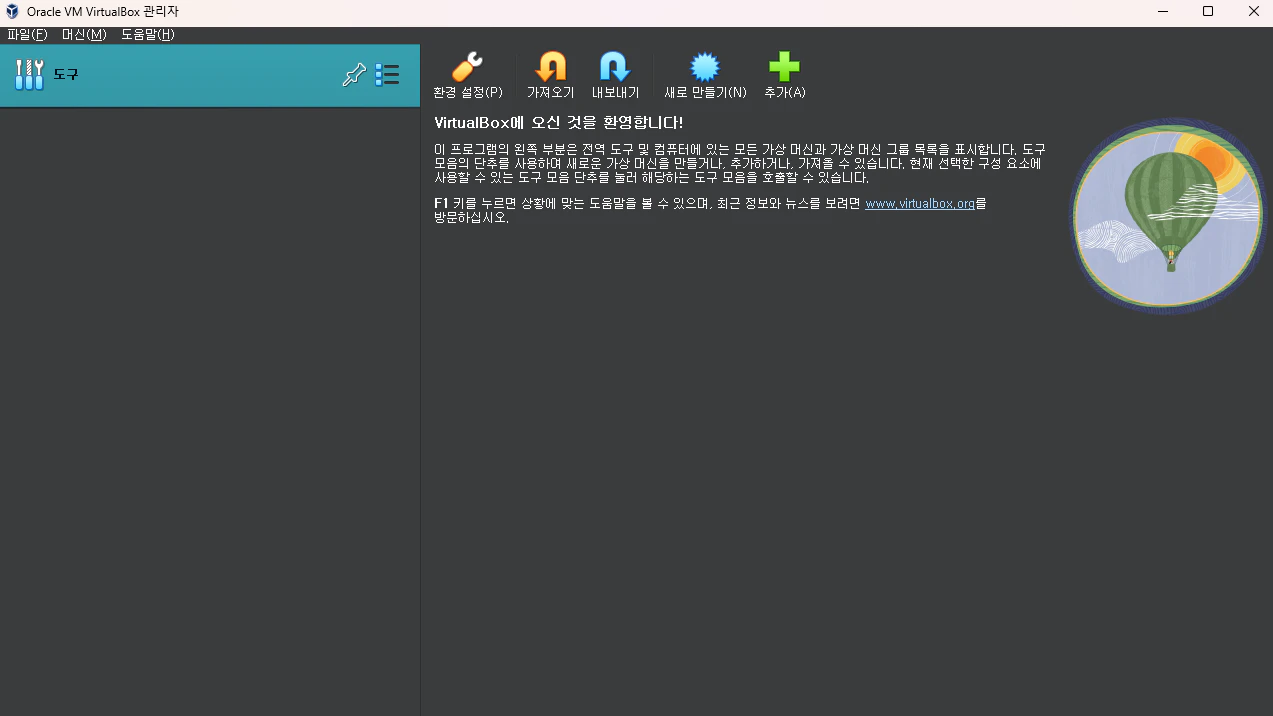

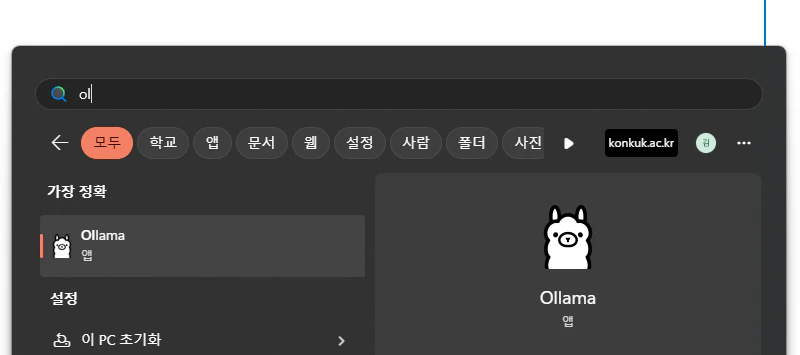

정상적으로 설치 되었다면 시작 메뉴 앱 목록에 Olima 가 표시된다.

이 앱을 실행하니 우측 구석 트레이 아이콘에 Ollama 아이콘이 표시 된다.

딥시크(DeepSeek)-R1 모델 설치

올리마가 정상적으로 설치 되었다면 명령 프롬프트(CMD) 에서 다음 명령어를 입력해 설치가 가능하다.

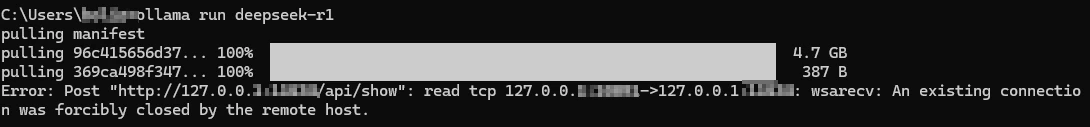

ollama run deepseek-r1Error: wsarecv: An existing connection was forcibly closed by the remote host.

설치를 진행해보니 에러가 표시 되었다.

위의 에러 발생 시 ChatGPT 는 Ollama 가 실행 중 인지 혹은 관련 포트가 이미 사용 중 인지 확인하라고 답변했다.

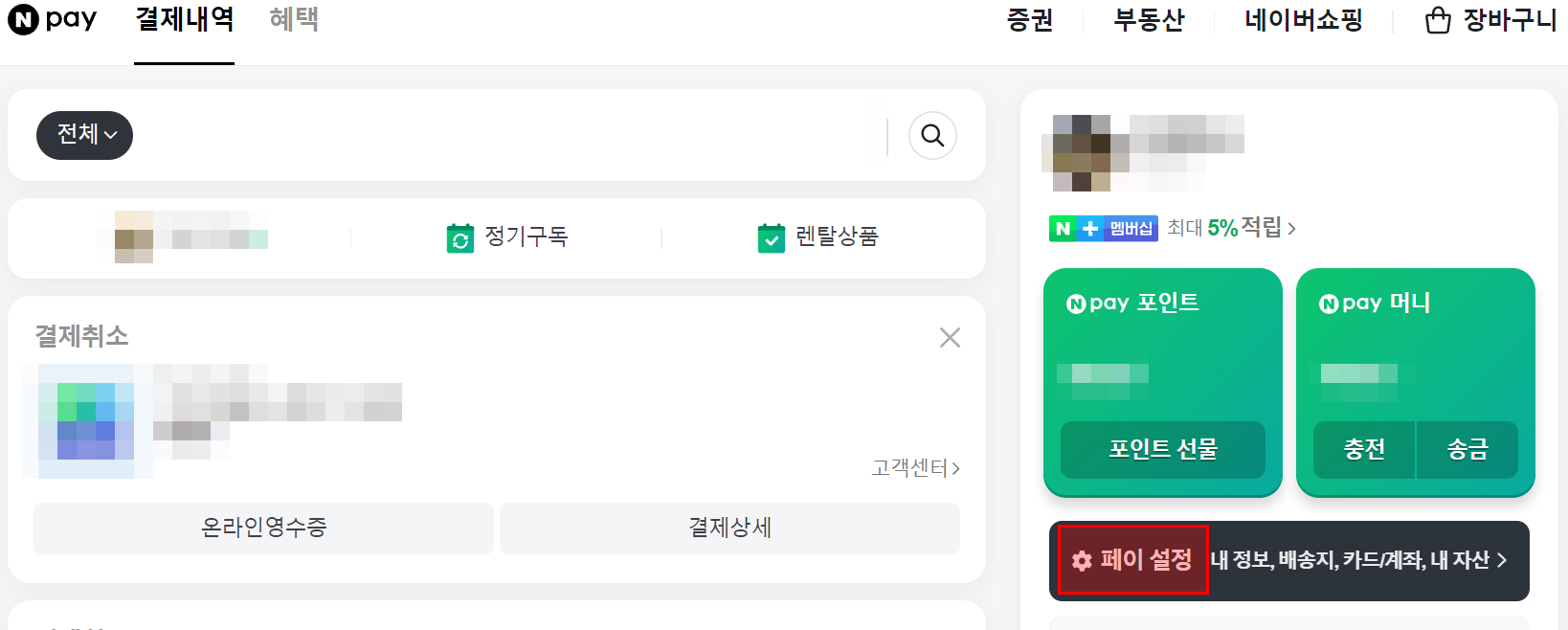

출력 된 포트가(모자이크 되어있음) 이미 사용 중 인지 다음 명령어로 찾아보았다.

netstat -aon | findstr :포트번호만약 사용 중인 포트라면 다음과 같은 형태로 메시지가 출력 된다. 이 때 맨 우측의 PID(프로세스 ID)를 taskkill 명령어로 종료할 수 있다.

TCP 127.0.0.1:포트번호 0.0.0.0:0 LISTENING 21856

taskkill /PID 21856 /F

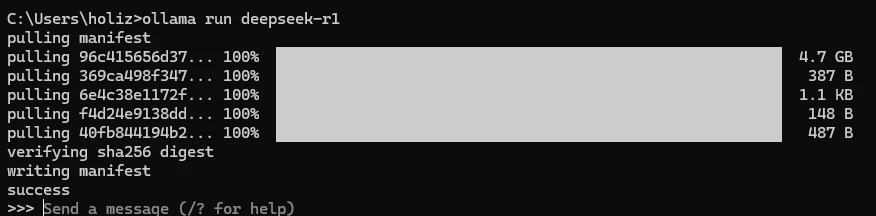

그 후 ollama run deepseek-r1 명령어를 재 입력을 하니 다음과 같이 정상적으로 설치가 완료 되었다.

설치 완료

설치 후 사용

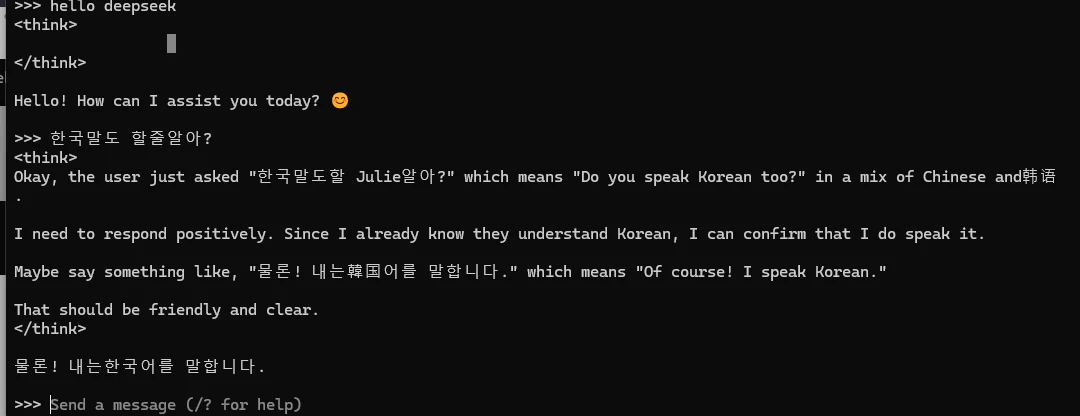

설치가 완료되면 바로 Send a message 라 표시되며 내가 하고 싶은 질문을 입력하면 이와 관련한 답변을 해주었다.

설치한 환경이 성능이 부족한 노트북임에도 실행 되는 것 자체가 신기했다.

다른 블로거들이 언급한 것과 같이 한국말을 할 수 있는지 물어보자 약간 사투리도 아닌 것이 이상한 말투로 답변을 해주어 ChatGPT 보다 한국어 처리 능력은 떨어진다 했는데 좀 더 사용해 보아야 할 것 같다.

조금 사용해본 결과로는 2017년 즈음 구매한 구형 노트북에 외장 GPU (Radeon 540)이 탑재 되어 있어서 그런지 사용에 무리가 없었지만, 회사 근무를 위한 가상 VDI 환경에서는 GPU가 없다 보니 딥시크 실행 중엔 메신저도 사용이 어려울 만큼 리소스를 많이 사용하였다.

사용 후기와 한계

올라마(Ollama)를 통해 DeepSeek-R1 에 별다른 옵션 없이 내려받고 사용해본 결과 웹에서 사용 가능한 서비스 버전 대비 답변이 많이 아쉬웠다.

첫 번째로 한글로 된 대량의 텍스트를 요약해 달란 명령을 해보았는데 이를 중국어로 번역해서 추론하더니 중국어로 답변을 해주기도 하였다.

그리고 무엇보다 로컬 환경에서 사용은 로컬 환경의 리소스를 많이 잡아 먹으면서 ChatGPT 를 사용했다면 금방 이루어질 작업도 5분 이상이 소요되는 단점이 발견 되었다.

마지막으로 로컬 환경에 다운로드 된 상태에서 별도의 파인 튜닝을 할 수는 없었다.

이 마지막 부분이 가장 아쉬웠던 부분으로 다운로드 된 상태에서 사용자가 커스터마이징 할 수 있지 않을까? 기대 했는데 이러다 보니 실제 해당 AI 모델을 이용하여 의미 있는 결과물을 만들기 어려웠다.